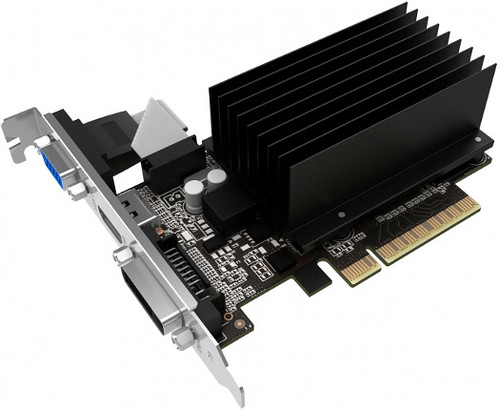

Cette « nouvelle » carte est en effet basée sur une « ancienne » puce Nvidia, le GPU Kepler GK208. Sur cette solution, la puce emploie 192 coeurs CUDA et propose une fréquence de 954 MHz tout en acceptant un maximum de 2 Go de mémoire vive au format DDR3.

Super ? Pas vraiment les dernières puces intégrées aux processeurs, que ce soit chez AMD ou Intel, fournissent le même niveau de performances graphiques que cette solution. C’est à dire pas beaucoup. L’idée de Nvidia est en fait double, d’abord de satisfaire les propriétaires de solutions existantes ne disposant que d’un vieux chipset graphique mais pouvant accepter de débourser une quarantaine d’euros pour profiter d’un chipset plus rapide. Et surtout de faire plaisir à ses clients constructeurs qui voient là un bon moyen de vendre des cartes en pagaille dans des solutions OEM composées sur mesure pour mettre en avant cette carte qui affiche des spécifications théoriques intéressantes.

En effet les fabricants et assembleurs pourront afficher un joli lot de nouveautés à leurs fichetechs : La GT 710 supporte DirectX 12, reconnait la technologie PhysX de Nvidia, le FXAA et la 3DVision. Elle gérera un affichage en 2560 x 1600 ce qui devrait faire fleurir l’habituel lot de stickers « 4K » en rayons. Elle fait également partie de la sphère des GeForce GT plus prestigieusement reconnues que les chipsets intégrés dans les processeurs.

De nombreux constructeurs se sont donc penchés sur le berceau de cette carte facile à produire et qui emploie en plus une mémoire très courante, la DDR3 au lieu des habituelles puces GDDR5 plus rapides et coûteuses. Un moyen marketing qui profitera à toute la chaîne, aussi bien à Nvidia qu’aux différents fabricants sans oublier les assembleurs, tous profiteront du subterfuge pour arrondir leur chiffre d’affaires sans apporter de vraie révolution niveau performances.

Pire, il est probable que certains engins récents disposants de chipsets graphiques intégrés à des Core i3 ou i5 finissent par écoper d’un GT 710 en rab. Absolument inutile et même contre productif, la carte prendra l’ascendant sur la puce interne plus rapide et moins gourmande, ils ne seront là que pour les mérites marketing de l’affaire. Le fameux prestige GeForce sur l’emballage.

Le constructeur EVGA propose une version ventilée de la GT 710, pour l’overclocking ?

Bonne à jeter alors la GT 710 ? Pas tout à fait, elle pourra rendre services à des clients particuliers. Pas forcément à ceux à qui le marketing des différentes marques la destine, cela dit.

L’Asus Pundit, une sortie VGA pilotée par un GMA 3100 et la possibilité d’ajouter une GT 710

D’abord aux propriétaires de machines ayant un chipset intégré très ancien (coucou les GMA 3xxx) qui pourront se réjouir d’une petite mise à jour pas trop coûteuse. Il profiteront ainsi d’une sortie HDMI par exemple là où les veilles bécanes étaient coincées en VGA seulement. Une évolution connectique qui pourra rendre de grands services surtout avec une prise en charge matérielle du H.264 et du HDCP par la puce Kepler GK208. Cela ouvre également la porte à une gestion multi écran. De quoi retrouver de bonnes performances en lecture vidéo et un OpenGL plus honnête. Ce n’est pas si mal si cela peut permettra d’attendre encore un peu avant de changer toute la bécane. L’après Skylake par exemple.

Ensuite, cela devrait séduire les utilisateurs Linux qui pourront ainsi profiter d’un pilote propriétaire développé et maintenu officiellement par Nvidia pour leur solution.

Des utilisateurs à mon avis très loin des préoccupations marketing des constructeurs qui se sont jetés sur cette aubaine, mais les seuls à pouvoir tirer un véritable bénéfice de ce type de carte.

| 2,5€ par mois | 5€ par mois | 10€ par mois | Le montant de votre choix |

Et elle ne nécessite pas d’alim supplémentaire. Pour ajouter du processing cuda sur une vieille solution, c’est pas mal du tout.

« Elle gérera un affichage en 2560 x 1600 ce qui devrait faire fleurir l’habituel lot de stickers « 4K » en rayons »

je ne saisis pas ? ou alors en comptant les largeurs de 2 écrans simultanés ?

Sinon pourquoi pas, l’occasion de mettre à jour un vieux PC à moindre frais tout en restant cohérent avec le matériel. Car finalement, à part rajouter un SSD et une deuxième barrette de RAM à un vieux PC, ce sont les seules opérations aisées hors changement complet de la CM

@Alain: C’est tout l’intérêt de la pastille 4K, elle ne veut rien dire et les néophytes la confondent avec Ultra HD. Regarde les spécifications réelles de certaines machines estampillées 4K, tu seras surpris de ce qu’elles affichent réellement.

j’en étais juste resté à 4K = 4x full HD = un-peu-moins-large-que-Ultra HD…

Si je comprends bien le logo 4k n’est pas déposé et utilisable, disons… pour un écran VGA affichant plus de 4000 couleurs ?! ;)

L’Asus Pundit (sur la photo de ce billet), ne semble accepter que les cartes « low Profile » (moins hautes que le cartes standards). Est-ce que cette carte est « Low Profile » ? Merci.

@Denony: ce sera effectivement un point à surveiller

en fait, surtout la vente dans la boite d’une équerre 2 pci (msi la fournit de temps en temps, gigabyte également – j’ai une préférence pour cette marque)

car pour avoir le vga, le hdmi et le dvi en sortie, sur une machine comme le pundit ici par exemple, il faudra mettre les sorties sur 2 équerres

à voir les solus vendu par les fabricants car on voit bien sur les photos plus haut que toute peuvent être configurer en low profil

s’ils ne sont pas « radins » en version boite (non oem), ils vendront la double équerre avec directement dans la boite

sinon exit le vga et une solution un peu « bancale » (carte pas fixé (c’est via l’equerre qu’elle tient, sinon juste via le port pci express) et vu le poids du dissipateur sur certains modèles, je le ferais pas perso) et un « trou » ou la poussière pourra également rentrer

si vous êtes bricoleur et avez un équerre pci de rab, aucun soucis, c’est facile à faire et marche impec

sinon, c’est pénible (surtout quand on a pas les outils)

mais à mon avis, vous aurez les équerres avec, pas de soucis (en tous cas chez les grandes marques reconnues, les noname et autres clone, sans doute pas)

@Will: si c’est intéressant pour mettre à jour de vieux pc

pour les pc « neufs », aucun intérêt ok mais pour les « vieux », si carrément

Je possède un vieux pc avec une MSI GeForce GT 210 (N210-MD512H), cette Nvidia GT 710, Est ce que ça vaut le coût?

@fafa: bof, perso je dirais non

sauf si votre carte actuelle n’est pas passive (mais une gt 210, c’était generalement passif de base)

comme ça, de but en blanc, je dirais non mais cela depends de votre usage (jeux pas jeux, fichiers lus – codecs, OS et si un de vos logiciel utilise la techno CUDA – et là, il faut voir)

le diffuseur compte aussi

en gros, si c’est juste pour lire du X264 sur un écran full hd par exemple, si votre carte est deja passive, inutile de l’acheter

Est-ce suffisant pour gérer le PhysX? J’en doute mais si ça peut soulager un GPU ^^

Bonjour,

Un article où sont comparées les GPU intel actuels avec les cartes graphiques low profile du marché.

http://techreport.com/forums/viewtopic.php?f=3&t=94408

sera t »elle compatible mac pro 2006/2007 et surtout plus rapide que mon ATI 4870 1 giga Ram ?

@Man: Je ne connais que peut l’upgrade Apomme, mais cela ne devrait pas poser de soucis en toute logique, en tout cas je ne pense pas me tromper en te disant qu’elle est beaucoup moins puissante que ton GPU actuel.

Merci orangina rouge pour tes conseils, que je vais suivre et ne pas prendre cette carte.

@fafa: à vous de voir, mais si effectivement c’est juste pour de l’affichage et du décodage vidéo sur un ecran 1080P max avec au mieux un codec comme le x-h264

oui, pas franchement la peine

la quarantaine d’euros (ou plus si frais de port) sera mieux investi dans un SSD par exemple pour redonner un peu de fraîcheur à votre pc

par contre, je ne sais pas quel est votre os ou si vous avez des applis prenant en compte la techno CUDA de nvidia qui accélère les calculs pour des logiciels comme ceux d’adobe par exemple, mais là, il faut voir

idem pour la machine « vieillissante », dites nous en un peu plus sur la config et srtout les usages

je peus me tromper et tomber à coté (surtout que vous semblez vouloir la « rafraîchir »)

sinon, perso j’ai par exemple une machine mini itx en core2duo pentium 6(3 je crois)00 avec un chipset nvidia embarqué du type geforce 9300 sous linux et les videos fullhd et bluray passent parfaitement dessus

idem pour ma veille tour recyclée chez un membre de ma famille avec un core2duo 4400 et la même carte que la votre

le pc est en dual boot et dual screen seven linux et à les mêmes besoins niveau multimédia

tout tourne impec

l’upgrade d’une carte graphique sert surtout pour les « effets » de windows et les jeux directX (mais pas sur ce type de carte premier prix à mon sens)

sinon nvidia avec sa techno CUDA est franchement sympa pour déporté des calculs lourds vers la (ou les) CG

comme pour le traitement d’image (blender sous linux marche avec il me semble par exemple sinon les logiciels adobe encore une fois), la video (encodage selon les logiciels et surtout décodage, mais là la plus petite carte gère generalement) ou des calculs scientifiques (imagerie médicale par exemple)

mais encore une fois, ce type de carte premier prix est assez cheap pour ce type d’usage, une carte plus pêchu est alors un ben meilleur investissement (generalement dans le milieu de gamme vu le taux roulement pour un pc de joueur ou très haut de gamme pour des besoins spécifique lourds et souvent en multi carte comme pour blender ou le monde médical)

là, c’est plus un produit marketing qu’autre chose

à moins d’avoir vraiment besoin des nouvelles normes hdcp et hdmi et encore

pour moi ça vaut pas le coup mais encore une fois, je peux me tromper ne connaissant pas vos besoins spécifique

bref, on en reparlera

bonne fin de week end à tous et à la semaine prochaine pour moi

Ca peut étre utile…

Bon, c’est sur, on ne pourras pas jouer au dernier jeux AAA dessus, mais ca permet de booster un peu certaine vielles machines…

Je suis un peu perdu avec ton avis sur la 4K.

SD 4/3 progressif = 720 x 576

SD 16/9 progressif = 1024 x 576

HD progressif = 1280 x 720

FHD progressif = 1920 x 1080

2K progressif = 2048 x 1080

4k UHD ou 4K HD progressif = 3840 x 2160

4K progressif = 4096 x 2160

Voila les formats et DCP qu’au boulot on envoi aux chaines de télé et cinéma.

2560 x 1600 c’est le classique « 2.5K » en 16/10. Ce qui veut dire que la carte pourra faire tourner des écrans de gamer 2560 x 1440 16/9 ou des moniteurs d’étalonnage de cette résolution.

Mais aucunement un écran 4K nativement, et s’ils osent mettre une étiquette 4K (bien que je sois d’accord avec toi, le terme est très mal employé et ils devraient mettre UHD, à l’heure actuelle il n’y que 2 marques qui ont proposé des écrans 4K 4096 x 2160) ce seront alors de gros vilains menteurs :D

Perso mon Athlon II de chez DELL a une RADEON 5450 en lieu et place d’une GT 310 .

Je souhaitai investir sur une Nvidia GT 750 TI qui parais t’il fonctionne sur ce type de PC DELL ,INSPIRON 570 (il me semble) .

Mon port PCI E est un type 2 en 16* ,la carte Nvidia GT 750 Ti coute 120/140 euros .

Ce qui m’intéresse dans une carte graphique c’est la possibilité de jeux et de décompression vidéo .

J’ai pas de gros jeux puissants style Fair Cry ou autres . pour la vidéo je souhaite juste que la télé en replay passe bien en HD .

Le dilemme c’est donc 40/50 euros ou 120 euros .

L’avantage de la GT 750 TI c’est qu’elle reste très intéressante pour une evolution matérielle type changement de carte mere .

Bref ,je pense que NVIDIA devrai un poil revoir le positionnement de ces cartes .

Autre point ,je pense qu’il serai plus logique d’avoir une carte graphique offrant la meme base évolutive

Faire par exemple une carte graphique identique pour tous les processeurs et sur laquelle seule changerai le GPU et la quantité de memoire .

Mon meilleur investissement, c’était une GTX 660 Ti à 170€ sur ebay. Une très bonne carte graphique en son temps, et qui peut me faire profiter vraiment de ma modeste machine (core i5 overclocké 4Ghz).

Si on veut investir dans une petite CGU sur une vielle machine, opter pour une vieille GTX 660, 750, 760 pour moi à 100€ c’est le meilleur rapport qualité prix. Après tout ce qui est en dessous de 40€ …

@ptitpaj:

L’athlon x2 commence à se faire vieux. La 750ti risque de ne pas être exploitée à fond. (on appelle ça « CPU limited » mais j’ai des doutes sur ces théories).

Pour le faire évoluer une 650ti en occasion sera surement suffisante.

En tous cas, les 5450, gt310 ou gt710 ne sont des cartes que pour ajouter des connecteurs vidéo, comme le dit Pierre, et pas pour booster un PC en jeu ou 3D.

@COoOL:

Merci pour le lien vers l’article que tu cites qui est effectivement très intéressant. Jusqu’ici j’appliquais le postulat que le GPU intégré dans les intel était si déplorable que toute CG était un upgrade intéressant. Or on y apprend que : « The GT 730 with DDR3 is actually slower than the HD 4600 on the i3-4360. The R7 250 with DDR3 is a marginal improvement over the HD 4600 – but given the prices of these cards, you’d be paying near $100 for a 15% improvement in performance. »

On a donc bien passé un cap, et il va falloir être désormais très attentif maintenant à l’intérêt d’une CG dédiée (pour les non-joueurs), surtout si les constructeurs de CG se mettent à faire des « sous-modèles ». Je conçois l’intérêt marginal, mais dans la valse des rebranding j’ai peur que tout soit fait pour perdre le consommateur lambda.

@ Un beau jour

Pierre nous explique, si j’ai bien compris, que le label 4K n’existe pas officiellement contrairement à l’UHD, et qu’il est donc parfois utilisé en « mentant légalement ».

Soit pour toute définition supérieure au full HD.

4K pouvant ainsi être interprété comme 2 écrans full HD ( 1920 + 1920 = pas-loin-de-4000 ), voire un seul 2560×1600 : ça peut être compris comme 2.5 Kpixel de large mais aussi comme 4 mega pixels affichés…

je n’ai pour ma part pas remarqué de tel dérapage jusque-là ( sans y avoir prêté attention non plus )

@Alain

Ok alors dans ce cas ce label de fabricant de ne veut strictement rien dire… et est là pour embobiner les acheteurs… Je peux à la limite comprendre qu’on utilise « 4K » au lieu de « UHD » même si l’aspect ratio et le nombre de pixels sont différents… (mais on n’a jamais dit 2K pour un écran 1080p … ).

Non en fait je reviens sur mes mots… Je ne comprends pas qu’on dise 4K au lieu de UHD, tous les jours je filme en RED Epic et j’ai des formats bien spécifiques à rendre aux clients, 4K c’est pas UHD et encore moins 2.5K.

Mais s’ils jouent sur les mots genre avec 2 ecrans HD pour dire 4K… ou pire le nombre de megapixel affiché… alors là c’est du grand n’importe quoi et ça fait 10 ans qu’ils auraient pu commencer à pratiquer ce genre de méthode…

Je ne comprends pas qu’aucune organisation ne fixe de règles une bonne fois pour toute.

Benji_X80,

vous dites une gtx sur ebay ok mais comment etres sur que c’est une vrai carte graphique,

et non une contre facon ? pouvez vous m’eclaircire sur ce sujet

cdlt.