Project Soli est une interface, un projet porté par Google pour apporter de nouvelles interactions entre les objets et l’environnement. Après son annonce, Google a ouvert la voie aux développements extérieurs et encouragés différents chercheurs à se saisir du procédé pour inventer de nouvelles formes d’usages.

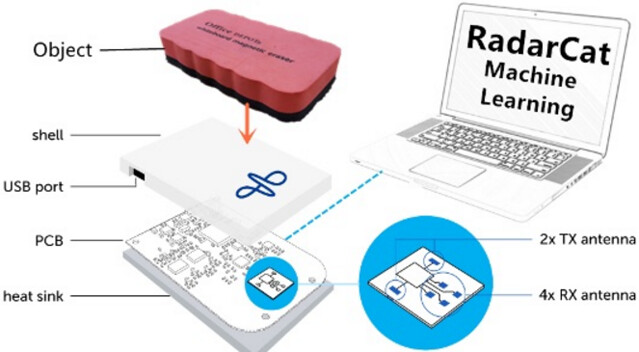

C’est exactement ce qu’a fait RadarCat. Né à l’université de St Andrews en Ecosse, RadarCat utilise la technologie de Project Soli, non pas pour permettre une interaction gestuelle entre l’homme et la machine, mais pour détecter les objets environnants.

Le procédé est assez simple à priori, Project Soli utilise des ondes électromagnétiques qu’il capte et interprète de manière très fine. Assez fine pour comprendre que vous êtes en train de frotter doucement votre pouce contre votre index et le traduire logiciellement. Cette finesse a été exploitée de manière différente par RadardCat.

En effet, l’équipe de St Andrews a pu concevoir une solution prenant en compte diverses caractéristiques d’un objet et en déterminer une sorte de signature électromagnétique. En interprétant sa forme et sa structure et en apprenant à la machine qu’il s’agit de tel ou tel objet, RadardCat utilise Project Soli pour comprendre et identifier un objet.

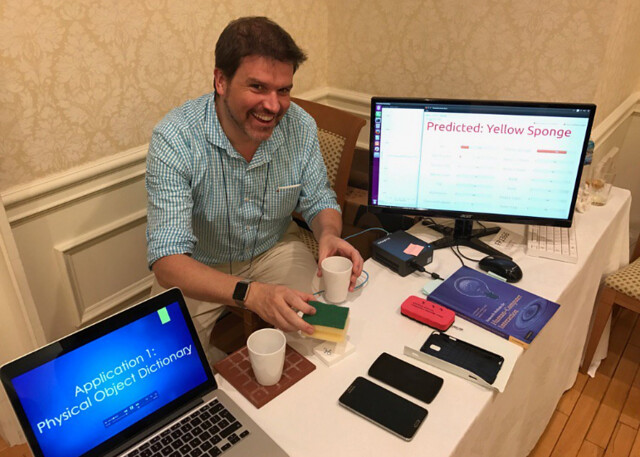

On présente une pomme devant le capteur puis on enseigne à la machine qu’il s’agit d’une pomme et l’engin pourra alors détecter et reconnaître une pomme. Un verre vide est présenté ? Il sera détecté avec une signature particulière. On le remplit d’eau, sa structure change et RadarCat change son identification pour préciser son état.

Le résultat est absolument incroyable au vu de la capacité des capteurs utilisés mais également de la possibilité d’intégrer Project Soli dans une smartwatch, un smartphone ou un objet connecté à un PC. On imagine évidemment l’immense service que l’objet pourrait rendre pour des personnes malvoyantes qui pourraient ainsi identifier à leur forme différents objets. Mais également de déduire de quel matériau un objet est constitué. Le fait de mutualiser l’apprentissage des formes et des objets via une application mettant en commun les bases de données serait un énorme plus. Cela permettrait de faire ses courses et de choisir des objets dont on n’a jamais entendu parler en pointant simplement son téléphone vers eux avant d’entendre simplement le nom de l’objet énoncé par son smartphone. Reconnaître un fruit exotique en voyage quand on n’en a jamais croisé n’est, par exemple, pas forcément des plus faciles.

Possible également de reconnaître un objet, d’en afficher le mode d’emploi sur l’écran de votre smartphone. De pointer une oeuvre ou un objet dans un musée et d’en connaitre le détail.

Mais les usages ne s’arrêtent pas là puisque la technologie pourrait également servir à faire des inventaires, à reconnaître les objets que vous mettez dans un caddie ou à identifier directement sur une balance ce que vous voulez peser. D’autres applications plus ou moins loufoques sont présentées par les équipes de RadarCat.

Plus d’infos sur le site de l’université.

| 2,5€ par mois | 5€ par mois | 10€ par mois | Le montant de votre choix |

c’est quoi la tablette sous ubuntu? :o sinon amusant le concept

[…] Il y a bien eu RadarCat, un projet universitaire basé sur Soli et qui reprenait cette idée l’année d’après. Mais depuis sa présentation le projet ne semble pas avoir bougé d’un poil. Et pourtant cette idée à un fort potentiel pour bien des usages. Du personnel médical serait surement ravi de disposer d’interfaces non tactiles pour piloter des appareils sans avoir a se laver une nouvelle fois les mains. Les personnes à mobilité réduites auraient bien évidemment un avantage a tirer d’un tel engin pour piloter par exemple du bout des doigts la vitesse de leur fauteuil sans faire des gestes plus complexes… Une simple télécommande classique avec un dispositif de ce type offrirait la possibilité de régler finement le volume sonore sans avoir a appuyer sur des boutons. Et bien d’autres usages sont possibles, d’autres types de gestes et autant de reconnaissance a interpréter. […]