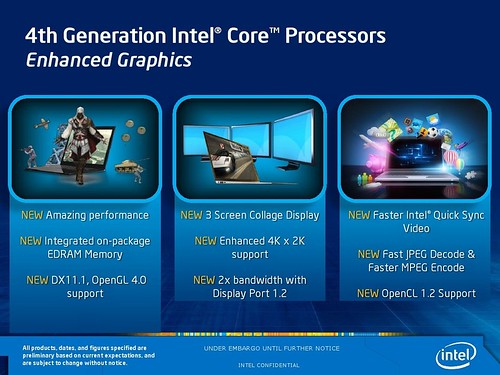

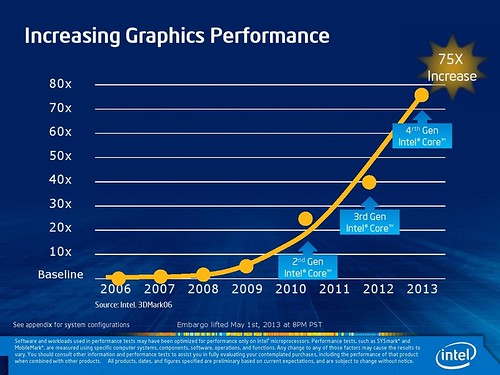

C’est une des promesse de ce changement de génération de processeur Intel, l’arrivée de la génération Ivy Bridge l’année dernière n’a pas eu de résultats véritablement délirants en terme de gestion graphique. Si la vidéo ne pose plus de problèmes aux processeurs de la marque, la 3D laisse encore à désirer. L’arrivée des puces de génération Haswell devrait changer la donne avec l’arrivée du chipset Intel Iris pour la gestion graphique.

Si les Intel HD Graphics habituels laissaient toujours planer un doute sur la performance des machines en terme de 3D, cette génération Intel Iris ouvre de meilleures perspectives. C’est probablement ce qu ia valu un nom à la série d’ailleurs, une manière de montrer une certaine reconnaissance à la puce qui gérera la 3D et sur laquelle le fondeur va probablement communiquer. En appuyant sur la possibilité d’exploiter un engin nativement un PC Haswell pour le jeu 3D sans avoir a choisir une version équipée d’une puce AMD ou AMD, la marque s’ouvre de nouveaux marchés.

Il ne faudra par contre pas s’attendre à des engins aux capacités équivalentes, si Intel promet de faire mieux qu’avant, la marque part de très loin face aux concurrents spécialisés qui proposent GeForce et Radeon depuis des années.

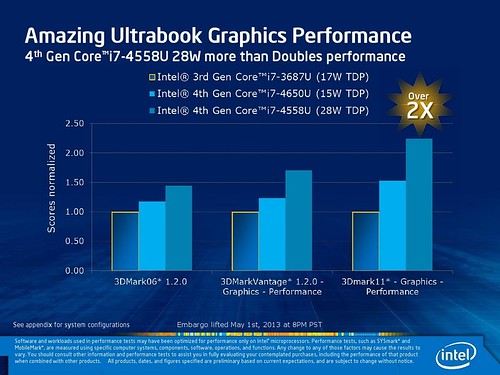

Les minimachines les plus avantagées seront sans doutes les nettops et les portables, les ultrabooks n’auront en effet pas droits aux processeurs Haswell les plus performants en Intel iris : Ceux ci affichent 25 watts de TDP ce qui ne colle pas avec le cahier des charges d’Intel : Cela dit les nouveaux I7-4650U, en 15 Watts de TDP, proposeront plus de performances que les Ivy Bridge 17 watts équivalents.

Un élément clé a prendre en compte lors de votre achat

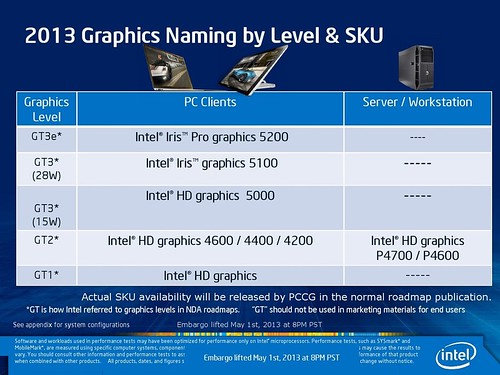

Il faudra donc désormais compter sur cet élément en plus pour choisir votre machine. La présence d’un système graphique intégré pouvant offrir des perspectives intéressantes il serait dommage de passer à côté. Intel va probablement communiquer sur ce point mais devrait surtout se focaliser sur le terme Core sans développer totalement les fonctionnalités spécifiques de la puce. Pour référence il y aura 5 puces graphiques intégrées dans les gammes de processeurs Haswell :

La référence basique restera « Intel HD » puis il y aura de plus spécifiquement détaillés les Intel HD Graphics 4600, Intel HD Graphics 5000 (intégré aux puces Haswell 51 watts des Ultrabooks) et enfin les Intel Iris 5100 et Iris Pro 5200 pour le haut de gamme de l’offre. Ces différences seront évidemment conditionnées au prix global de puce Intel Core et les plus haut de gamme seront intégrées dan les modèles les plus chers.

Il sera néanmoins opportun sur certaines configurations de choisir des solutions un peu plus onéreuses mais offrant des capacités plus étendues sans avoir a passer à des solutions équipées d’un chipset dédié plus gourmandes et/ou plus chères pour un même niveau de performances de calcul.

Ainsi l’Intel Core i7-4470R avec un TDP de 65 watts apportera aux portables traditionnels des performances qui devraient être satisfaisantes en terme de jeu. Le Core i7-4960HQ avec un TDP de 47 watts pourra aussi proposer des fonctionnalités correctes. 2 puces qui devraient se retrouver dans des nettops rapidement.

| 2,5€ par mois | 5€ par mois | 10€ par mois | Le montant de votre choix |

Tu voulais sans doute écrire « AMD ou NVIDIA ».

Intel se déciderait enfin à faire une bonne puce graphique ?

Mais est-ce qu’ils savent le faire ? Cela est vrai qu’ils partent de très bas, littéralement de plus bas que terre même !

Depuis 30 ans, ils se contentent d’acheter des licences pour des puces foireuses sans support ni drivers passé le système de référence au moment de leurs sorties.

Je trouve leur classification très obscure pour ce nouvel iris et je prends le pari que ca va encore pas le faire (sans risque) ! Oui c’est un peu négatif, mais vu le méchant passif de tout ce qui touche au graphisme chez intel…

Deux fois plus rapide que les HD3000 des ultrabooks Ivybridge, ça risque de ne pas être suffisant pour piloter les écrans Rétina lors des jeux (le nombre de pixels à calculer est quadruple, et non pas double). La toute nouvelle décompression H265 ne semble pas incluse non plus dans les HD5000.

Enfin bon, mieux vaut tard que jamais.

Il y a des rumeurs de rachat d’AMD par Intel. Puisque maintenant ARM est un concurrent sur le marché, AMD n’est plus utile aux avocats d’Intel lors des commissions d’enquête anti-trust. De plus, ça permettrait à Intel de mettre enfin la main sur des GPUs qui lui font dangereusement défaut.

Faut sortir les pincettes géantes, « jusqu’a 3x » ca veut dire « dans le test le plus favorable, bidonné a mort, en optiomisant a mort le nouveau et en sabotant l’ancien, on arrive a 3x… vous ne verrez jamais ca » :-p

Je n’ai toujours pas compris si H.265, qui est un dérivé de H.264, nécessite ou pas du hardware nouveau pour l’accélération GPU. Quelqu’un sait ?

M’est avis que le « jusqu’à 3x plus rapide » signifie juste qu’il y a 3x plus de shader ou un truc du genre.

D’un autre côté, entre des drivers approximatifs, qui consomment du CPU, et un système plus « bidouillé » genre optimus, je préfère encore la solution nVidia: pas de gros graphisme = intel, jeux ou graphisme = nVidia.

Je regrette juste que nVidia ait abonné son système initial « hybride » qui permettait d’activer manuellement (par un bouton, puis par un logiciel) le chip nVidia, au lieu de consommer un pouillième en plus tout le temps pour allumer de manière moins fine la carte graphique (en théorie « quand on en a besoin », mais avec nVidia et la config par défaut, c’est un peu tout le temps sauf si on modifie les réglages).

Bref, faut voir ce que ça va donner la nouvelle carte Intel en pratique, surtout en terme de consommation bureatique (car qui dit plus grosse carte graphique dit plus grosse consommation en utilisation bureautique). A mon avis, nVidia pourra toujours refourguer ses GFx10M, ou pour faire la différence des GFx35M.

Suite logique…

après avoir arrosé tout le monde avec des i3 i5 et i7 avec du HDx000 faiblart, un petit coup de comm pour inciter tout le monde à re-investir dans des puces à peine meilleures. On ne devient pas géant du CPU par hasard…

… on est sûr « minimachines » là ? :-)

@ obarthelemy : +1 !

Sur du GPU amélioré il y a ça :

http://www.tomshardware.fr/articles/mali450-arm,1-37651.html#xtor=RSS-11

Avec du quad core A9 à 2GHz par du fabricant « a pas cher » !!! Les Atom vont encore avoir du mal à ce faire une place.

@Skwaloo: Pour rappel de nombreux boîtiers de nettops savent dissiper de manière passive des puces de TDP de 65 watts…

Un GPU/VPU avec des performances honorables sans avoir à supporter un moteur d’avion pour le refroidissement, ça me va…

Je resterais aussi circonspect sur les annonces d’Intel concernant leurs solutions graphiques.

Pour commencer, ça fait déjà quelques années qu’ils nous annoncent de sérieuses améliorations sur chaque génération, avec des résultats toujours mitigés. La génération 3 était déjà annoncée comme deux fois plus puissante que la 2, on voit bien en pratique que ce n’est pas le cas.

Ensuite, le gouffre me semble toujours aussi présent: Les solutions dédiées sont actuellement une dizaine de fois plus puissantes que celles d’Intel. Elles aussi doublent de puissance tous les ans, et les développeurs en profitent pour produire des jeux toujours plus lourds. Et effectivement, les nouvelles normes de résolutions réclament elles aussi toujours plus de puissance, particulièrement en 3D.

Alors oui, c’est bien de voir qu’Intel planche sur la question, c’est même excellent de voir qu’ils progressent tout en réduisant la consommation de leurs puces, j’approuve totalement. Par contre, je ne m’attends pas à pouvoir faire tourner de jeux récent dessus dans des conditions acceptables. Et c’est complètement logique, on ne peut pas demander à une solution intégrée qui partage 15W avec le processeur de faire le poids même de loin face à une solution dédiée, équipée de 3GO de DDR et qui consomme 200W à elle seule.

En tout cas, on devrait déjà pouvoir faire tourner des petits jeux qui datent de 2-4 ans dans des conditions correctes pour un TDP de 15W.

Un nouveau pas vers des PC X86 avec les formes et autonomies de tablettes. :)